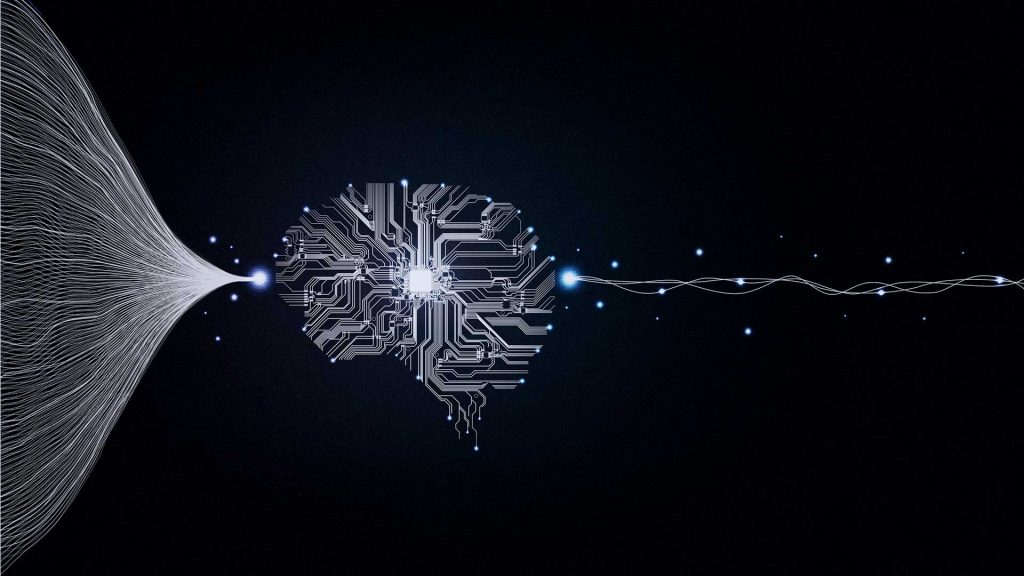

La empresa integrará un nuevo modelo en Azure Cognitive Services para respaldar las tareas de lenguaje visual. Así es el nuevo modelo de lenguaje visual de Microsoft.

Los investigadores de Microsoft han desarrollado un nuevo modelo de detección de atributos de objetos para la codificación de imágenes. VinVL (características visuales en lenguaje visual).

Los sistemas de lenguaje visual (VL) hacen posible buscar imágenes relevantes para una consulta de texto (o viceversa). También ayudan a describir el contenido de una imagen.

En la mayoría de los casos, los sistemas utilizan dos módulos para lograr la comprensión de VL. Un módulo de codificación de imágenes para generar mapas de características de una imagen de entrada. También un segundo módulo de fusión de lenguaje visual para mapear la imagen y el texto codificados en vectores en el mismo espacio semántico.

El nuevo modelo de lenguaje visual de Microsoft

La nueva investigación de Microsoft se centra en mejorar el módulo de codificación de imágenes. Cuando se combina con módulos de fusión VL como OSCAR y VIVO, el sistema VL más nuevo de Microsoft obtiene una gran puntuación en los benchmarks de Inteligencia Artificial más competitivos. Esto incluye la respuesta visual a preguntas (VQA), los subtítulos de imágenes de Microsoft COCO y los subtítulos de objetos novedosos (nocaps).

El gigante tecnológico también destacó que VinVl supera significativamente el desempeño humano en la tabla de clasificación de nocaps para la evaluación de descripción de imágenes basadas en consenso (CIDEr).

Microsoft entrenó su modelo de detección de atributos de objetos VinVL utilizando un gran conjunto de datos de detección de objetos. Este contiene 2,49 millones de imágenes atribuidas a 1848 clases de objetos y 524 clases de atributos. Con ello, logra los resultados mencionados anteriormente. Microsoft formó el conjunto de datos fusionando cuatro conjuntos de datos de detección de objetos públicos. A saber: COCO, Open Images, Objects365 y VG).

«Primero entrenamos un modelo de detección de objetos en el conjunto de datos fusionado. Después ajustamos el modelo con una rama de atributo adicional en VG, haciéndolo capaz de detectar tanto objetos como atributos». Esto lo dijo Microsoft en la publicación arriba enlazada.

«Nuestro modelo de detección de atributos de objetos puede detectar 1594 clases de objetos y 524 atributos visuales. Como resultado, el modelo puede detectar y codificar casi todas las regiones semánticamente significativas en una imagen de entrada, según nuestros experimentos».

A pesar de los resultados prometedores, Microsoft dijo que su modelo de ninguna manera se acerca al entendimiento de VL a nivel humano.

Microsoft también anunció que VinVL estaría disponible para el público para uso general. Además, integrará VinVL en Azure Cognitive Services para impulsar una amplia gama de servicios de Microsoft. Estos incluyen Image Captioning en Office y LinkedIn y Seeing AI.